Nasze doświadczenia z pierwszej ręki z technologią rozpoznawania obrazu AI, Google Lens, pokazały, że uczenie maszynowe z pewnością przeszło naprawdę długą drogę. Ale ta technologia jest obecnie daleka od doskonałości i nie tak inteligentna, jak się spodziewaliśmy, głównie dlatego, że tempo, w jakim trenujemy komputery do identyfikacji modeli, jest wolne. Ponadto niektóre AI wymagają zaawansowanych obliczeń dla sieci neuronowej iz pewnością nie jest to najłatwiejsze zadanie nauczenie maszyny.

Mając to na uwadze, grupa badaczy Google podjęła się przetestowania systemów rozpoznawania obrazów AI i sprawdzenia, czy można je oszukać, czy nie..

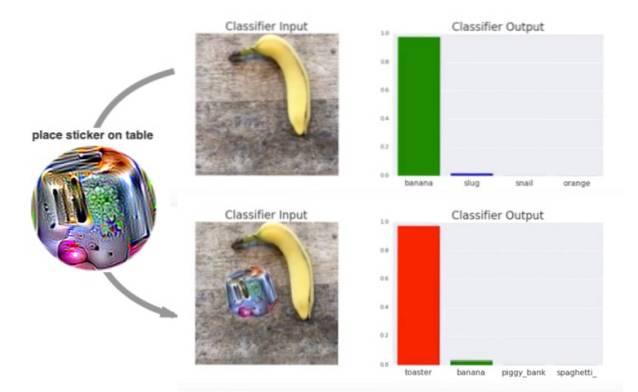

Wygląda na to, że odnieśli zwycięstwo od czasu System AI nie rozpoznał obiektu (tutaj banana) na przykładowych obrazach, a wszystko to dzięki specjalnie wydrukowanej psychodelicznej naklejce.

Stworzenie tych psychodeliczne naklejki, które mogą oszukiwać systemy rozpoznawania obrazów, jak opisano w artykule naukowym zatytułowanym Adversarial Patch, który właśnie został zaprezentowany na 31. konferencji na temat neuronowych systemów przetwarzania informacji w grudniu 2017 r. W artykule wyjaśniono, że naukowcy wyszkolili system przeciwnika (przeciwnika) do tworzenia małych, przypominających łaty, psychedelicznych okręgów z przypadkowymi kształtami, kolorami i rozmiarami, aby oszukać rozpoznawanie obrazu system.

Podczas gdy najczęstszą metodą oszukiwania systemów rozpoznawania obrazów AI jest zmiana obrazu poprzez dodanie do niego grafiki, naukowcy z Google postanowili oszukać system za pomocą projektów psychodelicznych.

Jak widać na poniższej demonstracji wideo, system jest w stanie rozpoznać banana i, do pewnego stopnia, toster, gdy umieścisz normalny obraz obok banana. Ale wyniki są mniej wyraźne, gdy obok banana zostanie umieszczony psychodeliczny wir:

Zespół odkrył również, że plik Poprawiony projekt wydaje się być oddzielony od tematu i nie ma na niego wpływu czynniki takie jak warunki oświetleniowe, kąty kamery, obiekty w widoku klasyfikatora i sam klasyfikator.

Badacze kontynuują wyjaśnianie działania projektów psychedelicznych:

Ten atak generuje niezależną od obrazu poprawkę, która jest niezwykle istotna dla sieci neuronowej. Ta poprawka może być następnie umieszczona w dowolnym miejscu w polu widzenia klasyfikatora i powoduje, że klasyfikator wyprowadza docelową klasę.

Chociaż na pierwszy rzut oka wygląda to na oszukane rozpoznawanie obrazu AI, ten eksperyment zostanie faktycznie wykorzystany do usunięcia niespójności w systemie. Osoby pracujące w tej dziedzinie muszą teraz dostosować się do zaszumionych danych, które mogą być zawarte w przedmiotowych obrazach. To odkrycie może dać systemom opartym na uczeniu maszynowym szansę na poprawę swoich umiejętności w walce z podobnymi oszustwami w przyszłości.

Gadgetshowto

Gadgetshowto