Mapy Google to oczywiście najpopularniejsze mapy i aplikacja do nawigacji, nie tylko na Androida, ale także na iOS. Jest to aplikacja umożliwiająca uzyskiwanie wskazówek dojazdu i wyszukiwanie pobliskich stacji benzynowych, restauracji lub szpitali. Jednak użytkownik Twittera natknął się na obraźliwe zapytanie, które kwestionuje algorytm wyszukiwania Google, zwłaszcza dlatego, że naraża małe dzieci.

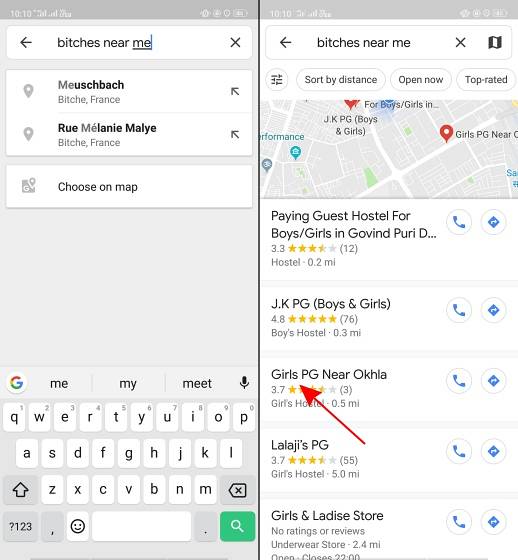

Jak donosi użytkownik Twittera @AHappyChipmunk, jeśli otworzysz Mapy Google i wyszukasz hasło „suki w pobliżu”, wynik wyszukiwania jest przerażający. Platforma wychwytuje ten obraźliwy slang (który potępiamy) i pokazuje szkoły dla dziewcząt, uczelnie, hostele i płatne apartamenty dla gości, co sprawia, że po prostu zatrzymujesz się na sekundę. W kraju takim jak Indie, gdzie ignoranckie części populacji używają obraźliwego słowa na N, aby się popisywać, nietrudno sobie wyobrazić wyszukiwane hasła, takie jak suki.

Google, czy możesz wyjaśnić, dlaczego to kurwa istnieje pic.twitter.com/w0eslFoVSz

- 🌻compañero avalakki ✨ (@Woolfingitdown) 25 listopada 2018

Ten tweet jest okropną niespodzianką, ale zobaczenie logo konta trolla na Twitterze (@trollenku) sprawiło, że sceptycznie odniosłem się do powyższego tweeta i początkowo pomyślałem, że to żart. Dopiero gdy sami użyliśmy tego samego zapytania, zdaliśmy sobie sprawę, że to nie tylko szkoły - algorytm Google zwraca wszystkie miejsca w pobliżu, które są związane z dziewczętami - w tym wypożyczalnie tylko dla dziewcząt i inne hostele.

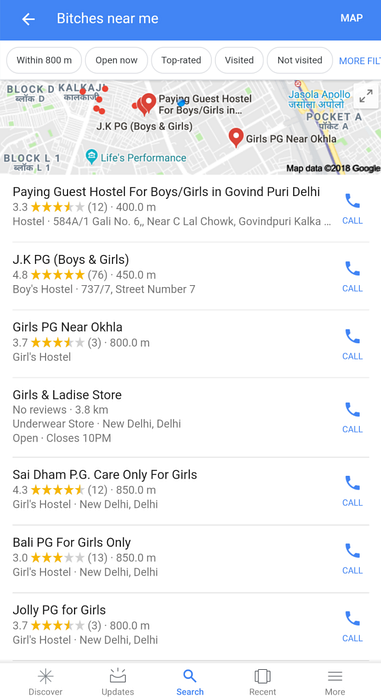

To samo dotyczy wyszukiwań Google dla tego wyrażenia:

Trzeba zrozumieć, że żadna osoba w Google nie jest za to odpowiedzialna. Wydaje się, że algorytm Google koreluje suki z dziewczynami, co po raz kolejny poddaje w wątpliwość stronniczość sztucznej inteligencji. W końcu maszyna nauczy się tylko tego, czego jej nauczysz.

Plik wynik wyszukiwania pokazuje ciemną stronę AI i jak popkultura może warunkować kojarzenie pewnych terminów z określoną płcią. Podkreśla również, jak myślą ludzie, którzy tworzą te algorytmy wyszukiwania. Firma Google powinna być szczególnie ostrożna po masowym strajku pracowników związanym z molestowaniem seksualnym w jej biurach na początku tego miesiąca. Domniemana „kultura braterska” w Google również przyniosła mu pozew lub dwa. A ta najnowsza gafa AI pojawia się w czasie, gdy widoczność jest wzmocniona dzięki ruchowi #MeToo w Indiach.

Wiele osób wysłało tweeta do Google, aby uzyskać więcej informacji na temat tego algorytmu. Przekażemy Ci aktualizację, gdy otrzymamy odpowiedź od firmy.

Gadgetshowto

Gadgetshowto

![Facebook w 2012 r. [Infografika]](https://gadgetshowto.com/storage/img/images/facebook-in-2012-[infographic]_2.jpg)

![1 na 5 właścicieli smartfonów regularnie korzysta z Twittera [badanie]](https://gadgetshowto.com/storage/img/images/1-in-5-smartphone-owners-use-twitter-regularly-[study]_2.jpg)